Die Google-KI Gemini, genauer das auf die mobile Nutzung getrimmte Modell Gemini Flash 2.0, bekommt neue Features, die am eben gestarteten Mobile World Congress in Barcelona vorgestellt wurden. So integriert

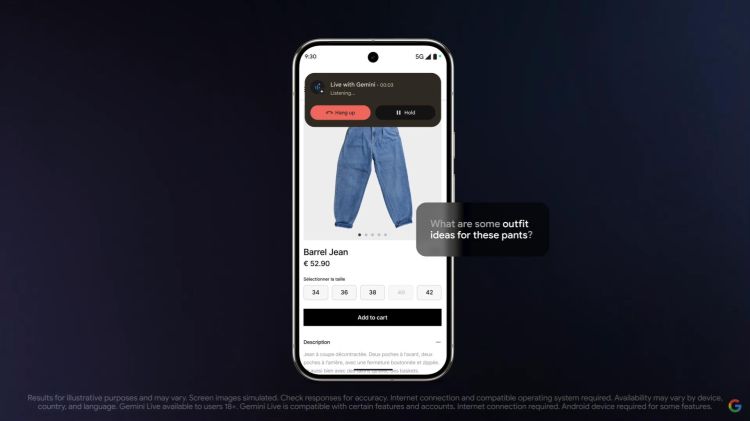

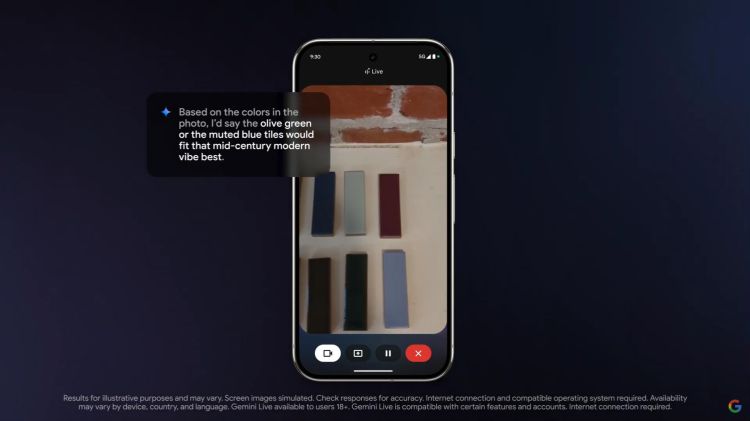

Google etwa eine Funktion, mit der die KI nun das Live-Bild der Smartphone-Kamera sowie Bilder auf dem Screen interpretieren kann. Man kann damit also künftig in Echtzeit Fragen zu Objekten stellen, auf die man die Kamera richtet, im von Google präsentierten Beispiel berät die KI den Nutzer etwa zur Auswahl von Farben einer Vase (siehe Video unten). Alternativ klappt das auch mit Bildern, etwa mit Screenshots. Hier gibt Gemini im Beispiel eine Kaufberatung für ein Paar Jeans ab. Die beiden Features sollen später im März ausgerollt werden, wie Google schreibt. Offenbar erstmal nur auf den eigenen Pixel-Geräten sowie Smartphones von

Samsung.

Weiter hat Gemini neue Sprachen gelernt – laut Google rund 45 verschiedene. Zwischen verfügbaren Sprachen kann jederzeit gewechselt werden, Gemini passt sich in Echtzeit an den User an. Die neuen Sprachen sind per sofort verfügbar.

(win)