Google hatte in der Vergangenheit stets unterstrichen, dass man KI-Technologie nicht zur Entwicklung von Waffen verwenden werde. Doch nun hat der Tech-Riese seine KI-Richtlinien überarbeitet und deutlich offener formuliert, wie einem Blogpost des Unternehmens zu

entnehmen ist. So heisst es neu, man werde bei der Entwicklung von KI-Systemen "angemessene, menschliche Aufsicht, Prüfungs- und Feedbackmechanismen festlegen". Ausserdem werden Massnahmen ergriffen, um schädliche Resultate zu vermeiden, wie es weiter heisst.

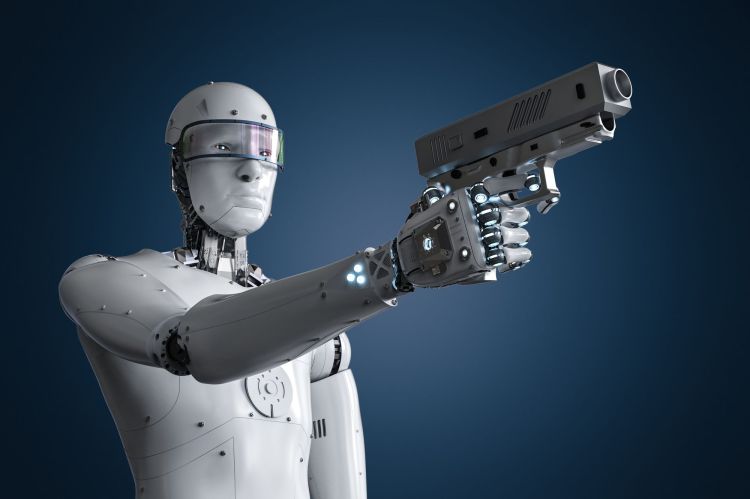

Das klingt zwar aller per se nicht schlecht, doch in den alten Richtlinien hatte das Unternehmen schwarz auf weiss niedergeschrieben, dass KI-Technologie nicht zur Herstellung von Waffen verwendet werden soll. Dieser Passus wurde entfernt.

Google begründet die neuen Ethik-Richtlinien mit sich ändernden KI-Standards sowie geopolitischen Auseinandersetzungen.

"Wir sind überzeugt, dass Demokratien bei der Entwicklung von KI führend sein sollten und dabei Werte wie Freiheit, Gleichheit und Respekt vor den Menschenrechten folgen sollten", schreiben James Manyika, Senior Vice President der Forschungsabteilung, und Demis Hassabis, Chef von

Deepmind.

(dok)